Social Media verändert nicht nur, was wir sehen – sondern auch, wie wir denken. Dieser Text zeigt, warum das ein demokratisches Risiko ist.

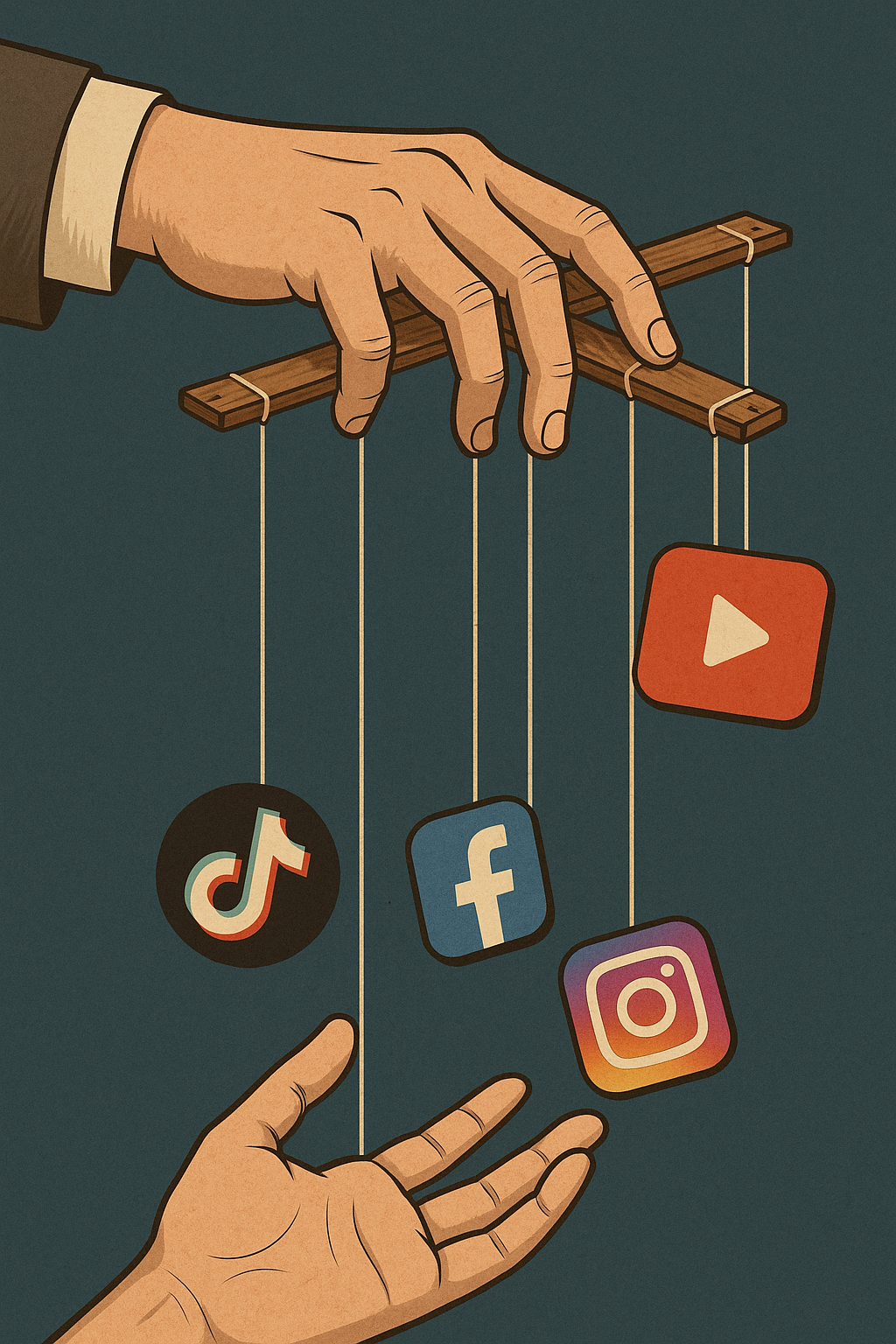

Die Illusion von Kontrolle

Was du auf Social Media siehst, ist kein Zufall. Es ist das Ergebnis eines algorithmischen Auswahlprozesses, der deine Aufmerksamkeit manipuliert, um sie maximal auszuschöpfen. Du glaubst, frei zu scrollen – dabei wirst du geführt. Nicht von Menschen, sondern von Modellen, die dich besser kennen als du dich selbst.

Dabei geht es längst nicht mehr um Information oder Verbindung. Es geht um Verweildauer, Engagement, Profit. Was auf der Strecke bleibt: Vielfalt, Nuancen, Menschlichkeit.

Der unsichtbare Filter: So funktionieren Social Media-Algorithmen

Algorithmen sind mathematische Vorhersagemaschinen. Sie analysieren dein Verhalten – Likes, Klicks, Verweildauer, sogar Pausen beim Scrollen – und berechnen daraus, was dich wahrscheinlich interessiert. Oder besser gesagt: was dich emotional triggert.

Früher war dein Feed chronologisch. Heute ist er kuratiert – personalisiert auf Basis deines digitalen Profils. Was du siehst, wird gefiltert, priorisiert, gewichtet. Aber nach welchen Kriterien? Nach den Maßstäben eines Unternehmens, das dein Verhalten monetarisiert.

Emotion schlägt Information. Polarisierung schlägt Differenzierung. Was dich aufregt, verkauft sich besser als das, was dich zum Nachdenken bringt. Willkommen in der Ökonomie der Empörung.

Vom Nutzer zum Produkt: Warum Aufmerksamkeit das neue Öl ist

Social Media-Plattformen sind keine neutralen Werkzeuge. Sie sind Unternehmen mit einem klaren Geschäftsmodell: deine Aufmerksamkeit in Werbeeinnahmen zu verwandeln. Je länger du bleibst, desto mehr Anzeigen kannst du sehen – desto wertvoller wirst du.

Deshalb optimieren die Algorithmen auf ein Ziel: Suchtähnliches Verhalten. Inhalte, die emotionalisieren, bekommen Vorrang. Skandale, Wut, Spaltung – alles, was dich nicht loslässt, wird verstärkt. Dabei geht es nicht um Qualität, sondern um Quantität: Klicks, Views, Shares.

Die Plattformen beobachten, wie du reagierst – in Echtzeit – und geben dir mehr von dem, was wirkt. So entsteht ein algorithmischer Tunnelblick, ein Feedback-Loop, der deine Wahrnehmung systematisch verengt.

Psychologische Folgen: Der Preis der Dauererregung

Was macht das mit uns? Studien zeigen: Wer häufig mit empörenden oder radikalen Inhalten interagiert, erhält immer extremere Vorschläge. Die Folge: emotionale Abstumpfung, Erregungsmüdigkeit – und Radikalisierung.

Besonders anfällig: Jugendliche. Sie wachsen in einer Umgebung auf, in der Sichtbarkeit über Likes definiert wird. Wer nicht performt, existiert nicht. Vergleiche mit Influencer-Idealen, ständiger Druck zur Selbstinszenierung, algorithmisch verstärkter Mobbingdruck – all das hat nachweislich negative Auswirkungen auf das Selbstwertgefühl und die psychische Gesundheit.

Der Algorithmus bewertet, ob du gesehen wirst. Nicht dein Umfeld. Nicht deine Persönlichkeit. Ein Code entscheidet über soziale Anerkennung.

Gesellschaftliche Folgen: Polarisierung als Systemeffekt

Algorithmen fördern nicht das Gemeinsame, sondern das Trennende. Inhalte, die spalten, polarisieren, empören, verbreiten sich schneller als solche, die erklären oder differenzieren. Die Plattformlogik belohnt Schwarz-Weiß-Denken.

Das hat Konsequenzen. Öffentliche Debatten werden emotionaler, lauter, flacher. Argumente werden durch Haltungen ersetzt, Diskurs durch Konflikt. Wer differenziert, verliert. Wer laut ist, gewinnt Sichtbarkeit.

Besonders gefährlich: Die Bildung von Echokammern. Algorithmen zeigen dir, was du sehen willst – oder besser: was dich in deiner Meinung bestätigt. Andere Perspektiven verschwinden aus deinem Sichtfeld. So wird aus der digitalen Öffentlichkeit ein fragmentiertes Meinungsnetzwerk ohne echte Kommunikation.

Die Entmenschlichung durch Technik: Warum Tiefe verliert

Gute Inhalte brauchen Zeit. Sie leben von Kontext, Differenzierung, Reflexion. Doch genau diese Qualitäten funktionieren schlecht im Aufmerksamkeits-Wettbewerb. Der Algorithmus bevorzugt Einfachheit, Emotion, klare Feindbilder. Was nicht sofort klickt, wird aussortiert.

So entsteht eine Kultur der Oberflächlichkeit. Empathie, Ambivalenz, Nachdenklichkeit verlieren Reichweite. Wir verlernen, zuzuhören, zu verstehen, Komplexität auszuhalten. Der öffentliche Diskurs verkommt zu einem Strom aus Reizen – laut, grell, ziellos.

Was bleibt, ist kein Dialog mehr, sondern ein gegenseitiges Überbieten in Aufregung. Eine Gesellschaft in Daueranspannung.

Transparenz und Regulierung: Verantwortung für die Systeme

Die Verantwortung liegt nicht nur bei den Nutzerinnen und Nutzern. Auch die Plattformen müssen zur Rechenschaft gezogen werden. Sie gestalten digitale Öffentlichkeit – und damit demokratische Realität.

Es braucht Transparenz: Wie funktionieren die Algorithmen? Wer kontrolliert sie? Welche Werte fließen ein? Solange diese Fragen unbeantwortet bleiben, fehlt jede Form demokratischer Kontrolle.

Staatliche Regulierung darf kein Tabu sein. Plattformen beeinflussen Meinungsbildung, politische Willensbildung, gesellschaftliches Miteinander. Das ist kein technisches Detail, sondern ein verfassungsrelevanter Bereich.

Medienkompetenz als Widerstand: Was wir lernen müssen

Gleichzeitig braucht es eine neue digitale Bildung. Medienkompetenz ist heute Überlebenskompetenz. Wir müssen verstehen, wie digitale Systeme wirken – auf unsere Emotionen, unser Denken, unser Verhalten.

Das beginnt nicht bei der Frage „Wie poste ich richtig?“, sondern bei der Fähigkeit, den Mechanismus zu durchschauen. Wer erkennt, wie der Algorithmus arbeitet, kann sich ihm nicht vollständig entziehen – aber ihm bewusster begegnen.

Reflexionsfähigkeit, kritisches Denken, emotionale Selbstregulation – das sind die Werkzeuge gegen Manipulation. Sie gehören nicht nur in die Schule, sondern in jeden Bildungsbereich, in jedes Alter, in jede Redaktion, jede politische Institution.

Fazit: Der Preis der Bequemlichkeit

Wir alle profitieren von der Bequemlichkeit personalisierter Inhalte. Aber sie hat ihren Preis: Wir verlieren Kontrolle über das, was wir für Realität halten. Die größte Gefahr liegt nicht im Kontrollverlust – sondern in der Illusion, alles im Griff zu haben.

Solange wir nicht erkennen, wie tiefgreifend Algorithmen unsere Welt filtern, werden wir ihre Folgen unterschätzen. Wer frei bleiben will, muss lernen, Misstrauen zu kultivieren. Nicht aus Angst – sondern aus Selbstschutz.

Was hat Social Media mit deinem Denken, Fühlen, Handeln gemacht? Hast du Momente erlebt, in denen du dachtest: „Das bin ich nicht mehr“? Teile deine Erfahrungen – und lass uns darüber sprechen, wie wir digitale Räume zurückerobern können.

Quelle: MEEON #7

Titel: Wie Social Media-Algorithmen unsere Wahrnehmung verzerren – und warum das gefährlich ist

Bilder: MEEON